Dokumentation: WG OpenAI

Dokumentation des JTL-Shop Plugins

Stand: 09.05.2023

Beschreibung / Vorteile

Das WG OpenAI-Plugin ermöglicht es Ihnen, qualitativ hochwertige Artikeltexte durch die Kombination künstlicher Intelligenz und maschinellem Lernen zu erstellen.

Es bietet eine benutzerfreundliche Oberfläche, mit der Sie unzählige Möglichkeiten der Fragestellung haben.

Mit Hilfe der Fragen-Template & Kategorieverwaltung können Sie sehr feinkörnige Fragentemplates erstellen. Mit seiner fortschrittlichen Technologie erstellt OpenAI verschiedene Artikelversionen, die jeweils einzigartig und informativ sind.

Mit unserem WG OpenAI Plugin können Sie schnell qualitativ hochwertige Artikeltexte generieren und smart verwalten. Ideal auch für SEO Agenturen als unterstützendes Tool.

Voraussetzungen

- JTL Shop Version min. v5.1.0

- OpenAI Konto und API Key

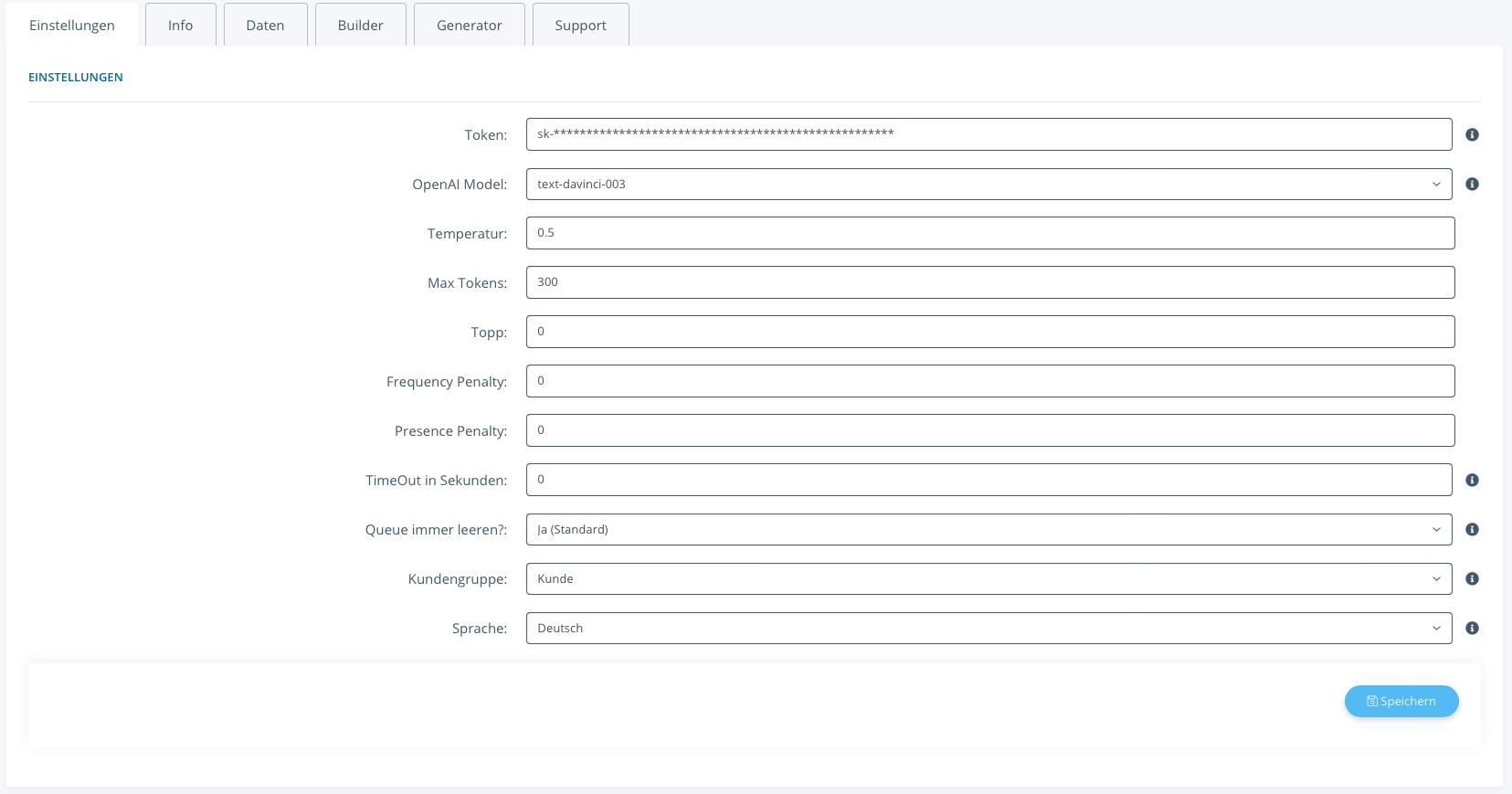

Einstellungen

Erläuterung der einzelnen Parameter

| Token: | Nach der Installation muss der OpenAI API Token in den Einstellungen hinterlegt werden. Gehen Sie dazu auf Api Keys und erstellen einen neuen Token. |

| OpenAI Model: | Model was verwendet werden soll. (Gegenwärtig nur eins) |

| Temperatur: | Definiert die Wahrscheinlichkeitsverteilung der nächsten Wörter oder Tokens. (Siehe Hinweise) |

| Max Tokens: | Definiert die maximale Anzahl an Token. Bei zu geringem Wert schneidet die KI den Text ab bzw. gibt unvollständige Antwoten. (Siehe Hinweise) |

| Topp: | Der Parameter topp ist ein Hyperparameter in OpenAI, der die Zeitbegrenzung für das Trainingsalgorithmus der KI bestimmt. (Siehe Hinweise) |

| Frequency Penalty: | Frequency Penalty ist ein Parameter in openai, der die Häufigkeit eines bestimmten Verhaltenssteuersignals kontrolliert. (Siehe Hinweise) |

| Presence Penalty: | Der Presence Penalty ist ein Parameter in OpenAI, der ein Maß dafür ist, wie lange ein Agent in einer Umgebung verweilt, bevor er eine Aktion ausführt. (Siehe Hinweise) |

| TimOut in Sekunden: | Definiert wie lange die Server Anfrage an die KI dauern darf bevor abgebrochen wird. Std:60 (zu kleiner Wert führt zu Fehlern) |

| Queue immer leeren?: | Wenn unter Generator neue Texte generiert werden sollen, wird aus der Auswahl (Kategorien) betroffene Artikel in eine Warteschlange geschrieben. Empfohlen ist diese bei jedem neuen Durchlauf vorher zu leeren. |

| Kundengruppe: | Definiert welche Kundengruppe soll verwendet werden. Insbesondere wenn Sie Kundengruppenspezifische Informationen in Templates verarbeitet werden sollen. (Bspw. Preis) |

| Sprache: | Definiert welche Sprache in Templates für das laden der Artikelinformationen verwendet werden soll. |

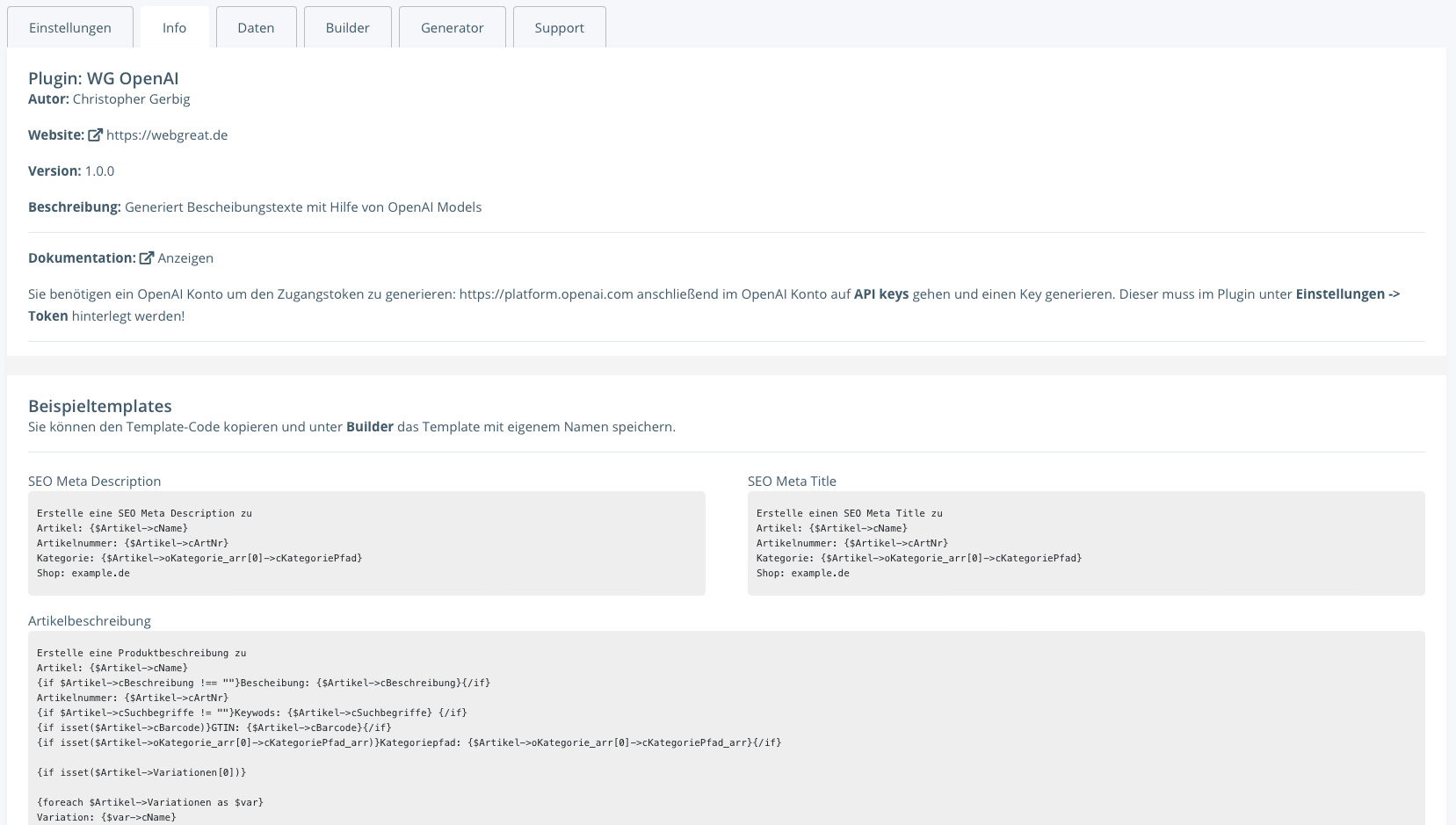

Info

Hier finden Sie kurze Hinweise zur Bedienung und drei Beispieltemplates

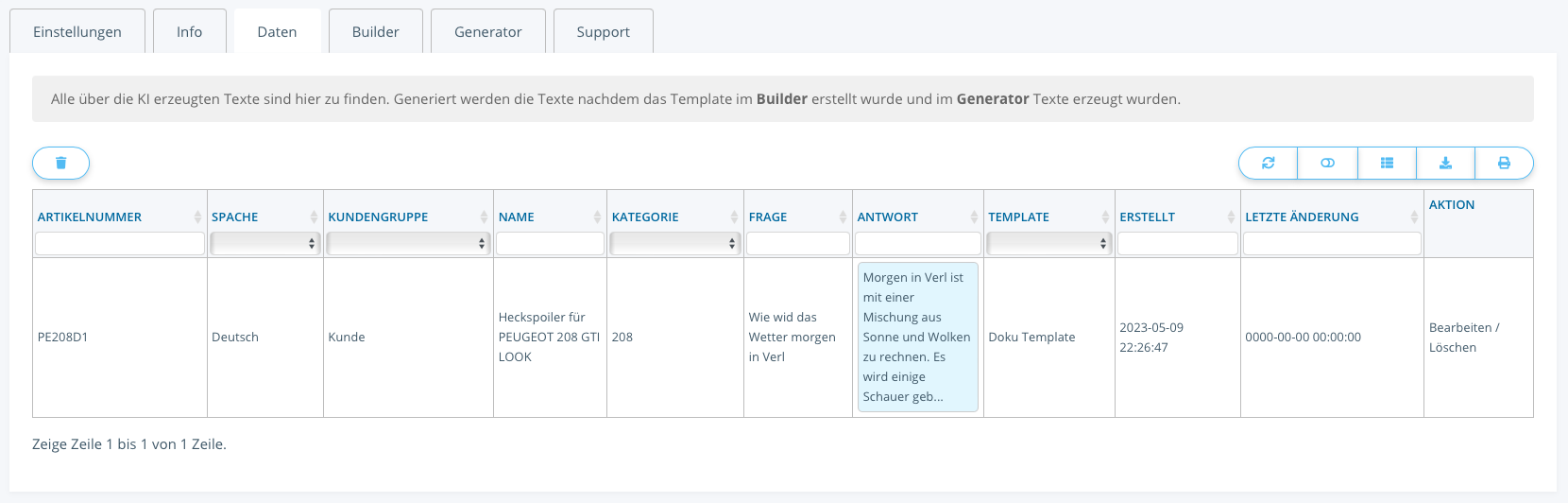

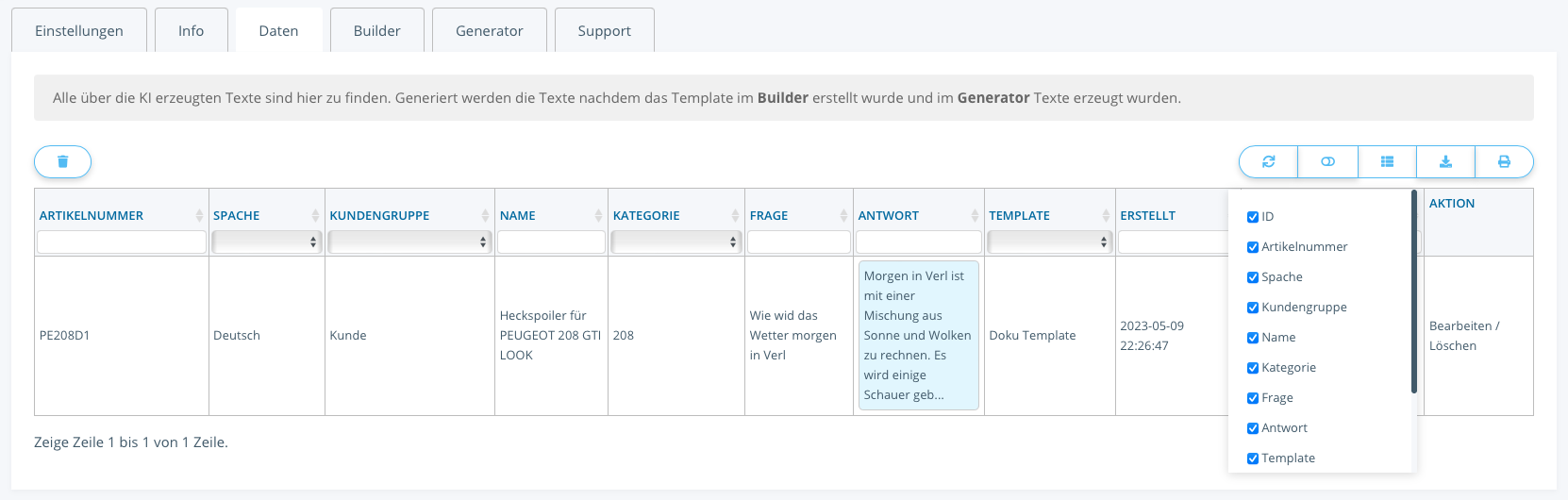

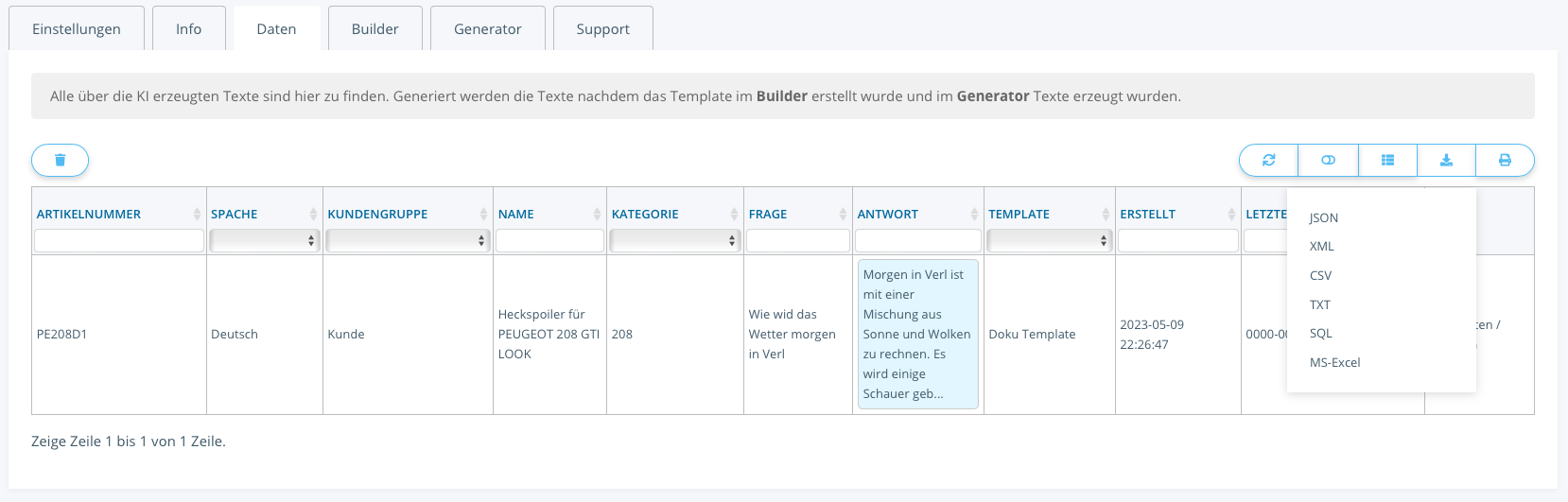

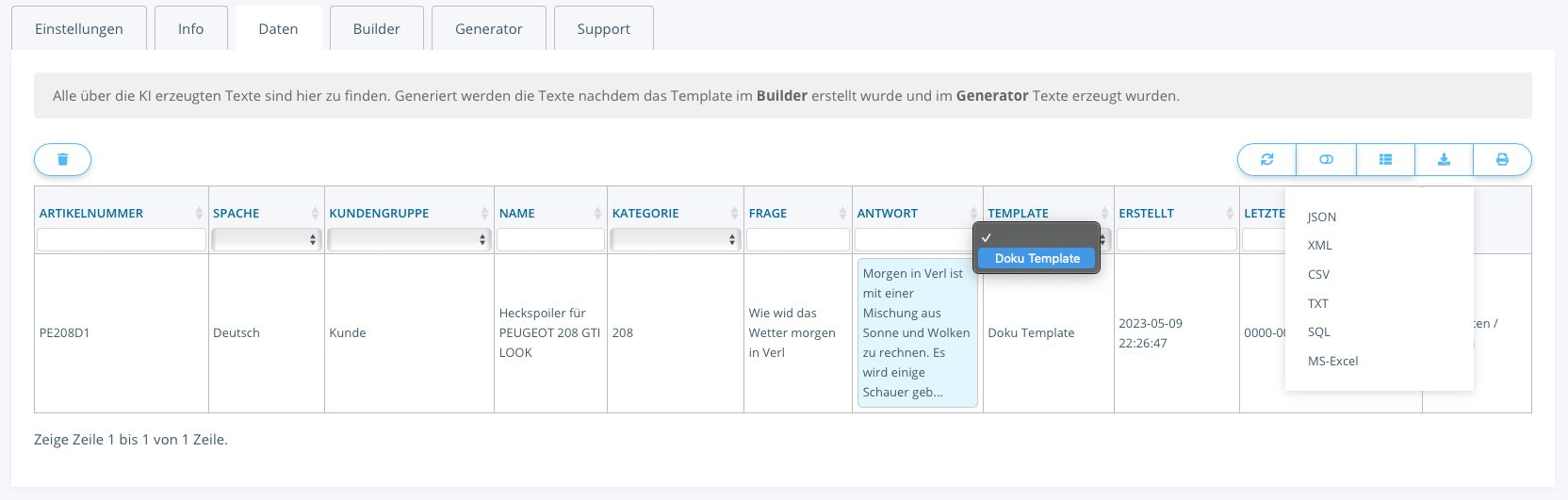

Daten

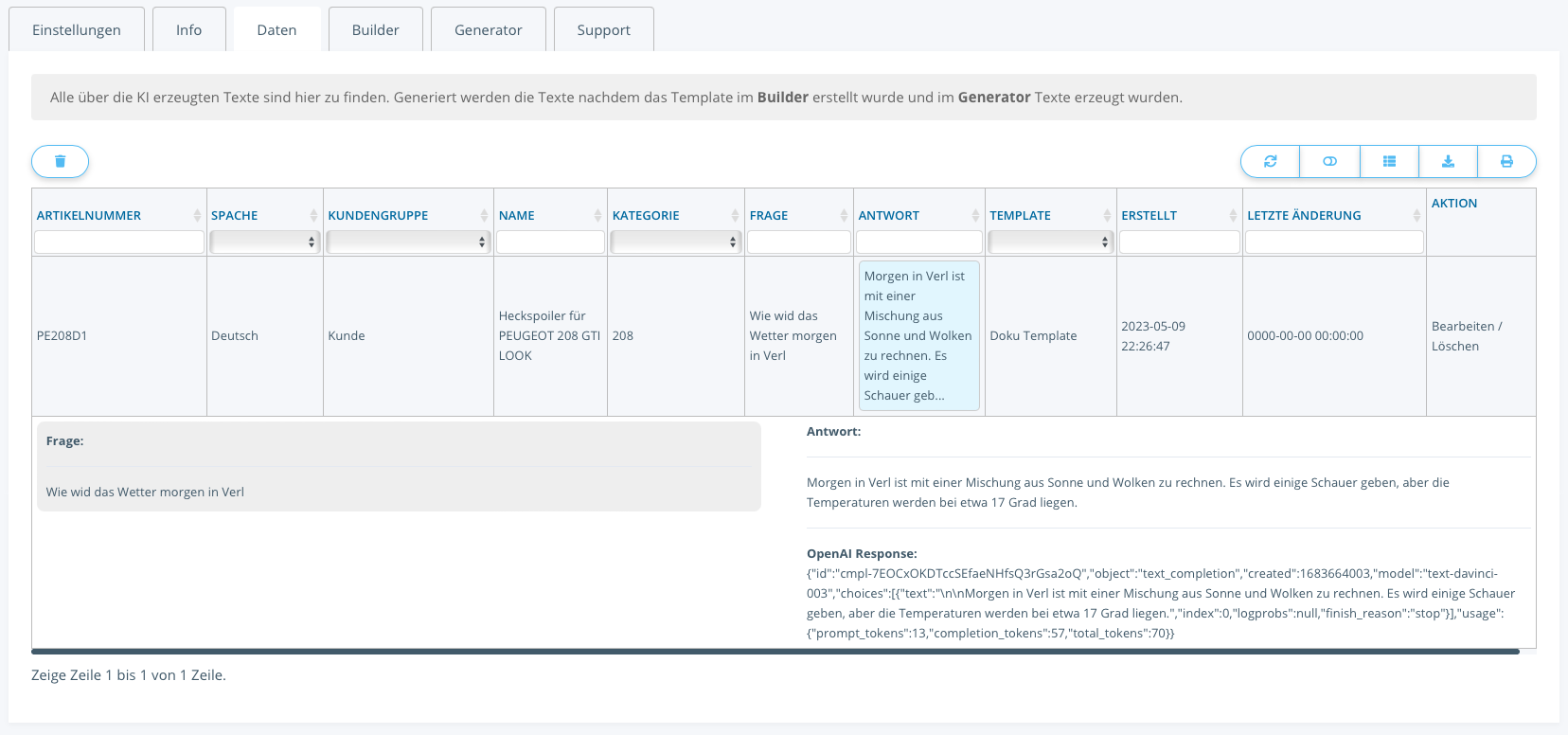

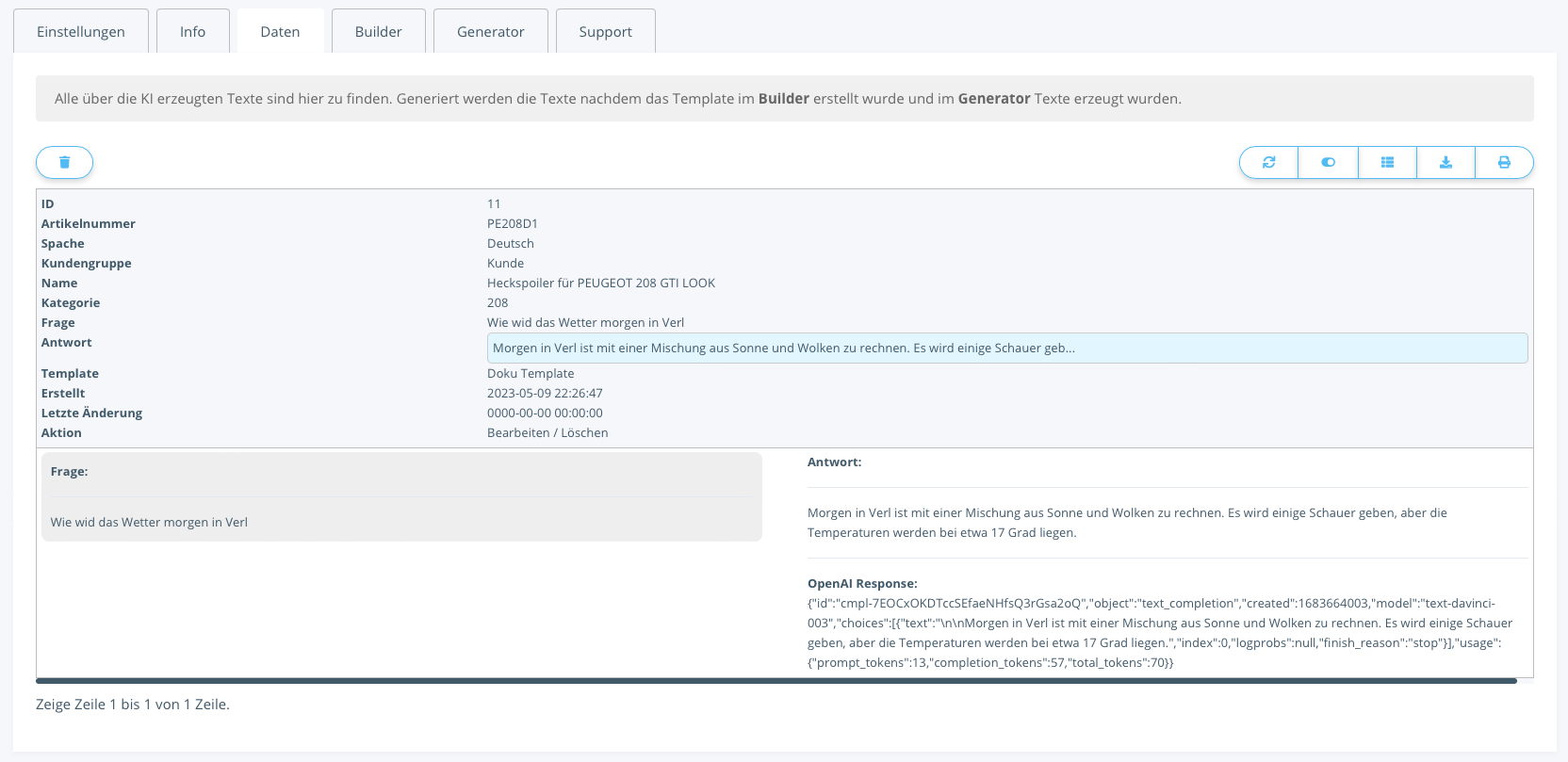

Alle generierten Texte werden unter Daten in einer Datentabelle angezeigt. Filtermöglichkeiten über Auswahlboxen oder Freitextfelder sind möglich.

Bei Bedarf können einzelne Spalten ausgelendet werden.

Verschiedene Exportformate erleichtern die Weiterverarbeitung der Daten

Input und Select Filter erleichtern die Navigation

Detailansicht mit Klick auf den Antworttext (blau)

Listenansicht um Details aller Daten sofort sichtbar zu machen

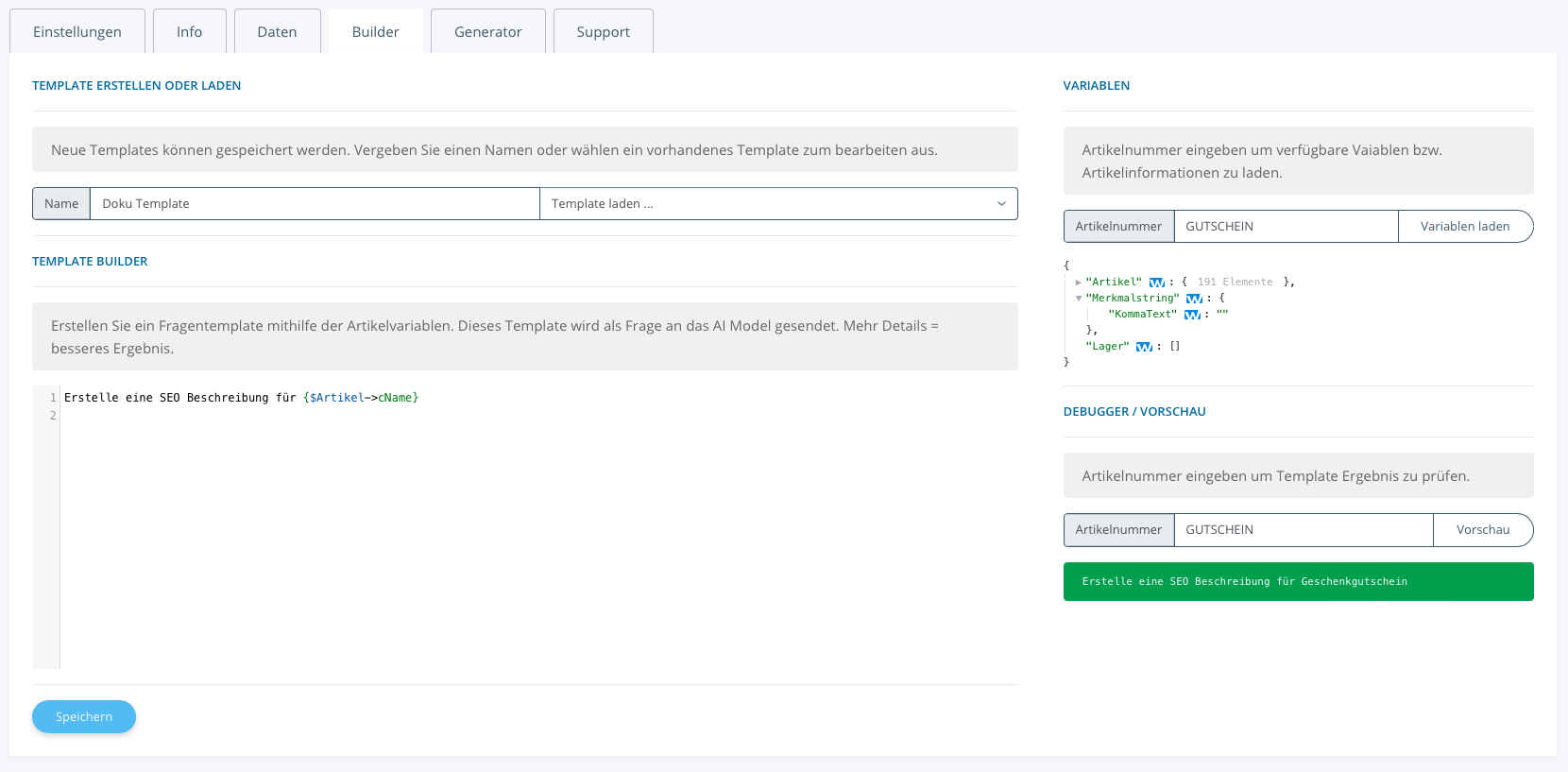

Builder

Erstellung von Fragentemplates erfolgt im Builder.

Um ein neues Template zu speichern, muss ein Name vergeben werden. Anschließend auf speichern.

Vorhandene Templates können mit wählen des Templates geladen und verändert werden.

Das Template kann mit Artikelinformationen als Smarty Variablen gefüllt werden. Dazu auf der rechten Seite unter Variablen eine vorhandene Artikelnummer eingeben und auf Variablen laden

klicken. Es wird ein klickbarer Variablen-Baum aller Artikelvariablen / Informationen geladen. Mit Klick auf das kleine blaue W für (Webgreat) wird die entsprechende Variable an der Cursor Position eingefügt.

Um eine Voschau des Fragentemplates zu laden, muss unter Debugger / Vorschau eine gültige Artikelnummer eingegeben werden und mit Klick auf Vorschau

wird das Template darunter in grün angezeigt.

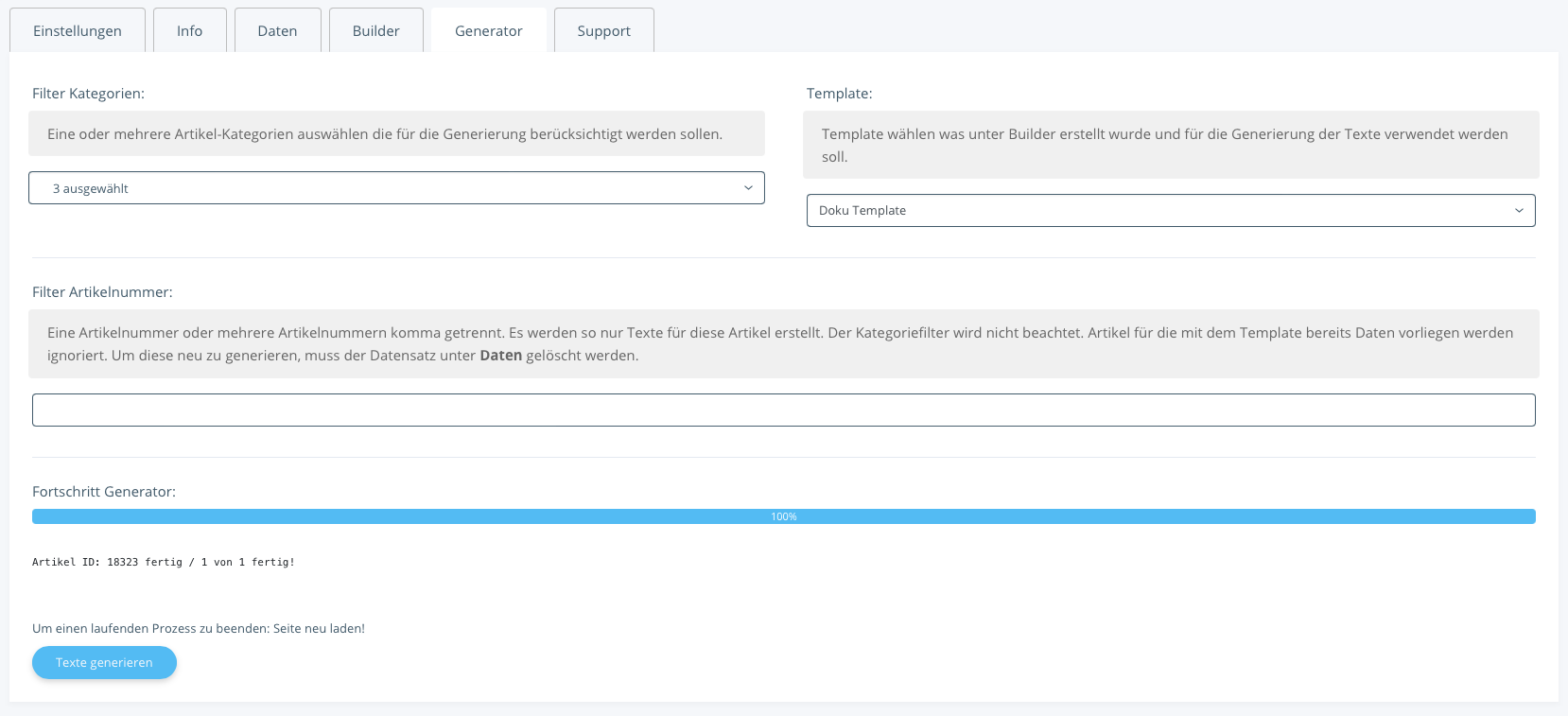

Generator

Um letztendlich Texte über die KI zu generieren, müssen die Kategorien gewählt werden für die Artikeltexte erstellt werden sollen.

Es kann eine, mehrere oder auch alle Kategorien gewählt werden. Das Template was zuvor erstellt wurde wählen und mit Klick auf Texte generieren werden die Artikeltexte erstellt. Der prozentuale Fortschrittsstatus wird angezeigt

Während des Prozesses ist es möglich unter Daten "Live" die Generierung zu verfolgen.

Um den laufenden Prozess zu unterbrechen/abzubrechen, muss ein Seiten reload (Windows: F5 / Mac: Command+R) ausgelöst werden.

Hinweise

Erläuterungen im Detail Temperatur:Der Parameter Temperatur bestimmt, wie mutig das openAI-Modell bei der Generierung von Text ist. Je höher der Parameterwert ist, desto wahrscheinlicher ist es, dass das Modell neue und unerwartete Wörter oder Sätze generiert. Ein niedriger Wert wird tendenziell zu vorhersehbaren, sicheren Ergebnissen führen, während ein hoher Wert zu neuen und unerwarteten Ergebnissen führen kann.

Erläuterungen im Detail Max Tokens:

Max Tokens ist ein Parameter in OpenAI, der die maximale Anzahl von Tokens in einem Textstück festlegt. Es wird verwendet, um die Anzahl der Wörter in einem Textstück zu begrenzen, was für die Erstellung von Textmodellen von entscheidender Bedeutung ist.

Erläuterungen im Detail Topp:

Der Parameter Topp in OpenAI Gym ist eine Einstellung, die bestimmt, wie viele Zustände der Agent erkunden kann, um die Umgebung zu erkunden. Je höher der Wert des Parameters Topp ist, desto mehr Zustände kann der Agent erkunden. Der Parameter Topp ist besonders nützlich, wenn der Agent in einer unendlich großen Umgebung lernt, da er die Anzahl der Zustände, die der Agent beim Lernen erkunden muss, begrenzen kann.

Erläuterungen im Detail Frequency Penalty:

Frequency Penalty ist ein Parameter, der in openai verwendet wird, um die Balance zwischen Explorations- und Exploitationsschritten zu halten. Dieser Parameter bestimmt, wie hoch die Strafe ist, die ein Agent erhält, wenn er eine bestimmte Aktion häufig wiederholt. Je höher der Parameterwert ist, desto mehr wird ein Agent dazu ermutigt, neue Aktionen auszuprobieren, da er bei der Wiederholung einer Aktion eine höhere Strafe erhält. Dadurch wird sichergestellt, dass der Agent sowohl explorieren als auch explotieren kann, um eine bessere Leistung zu erzielen.

Erläuterungen im Detail Presence Penalty:

Presence Penalty ist ein Parameter in OpenAI, der verwendet wird, um das Verhalten eines Agenten beim Lösen eines Problems zu beeinflussen. Der Presence Penalty wird als Belohnung oder Strafe angewendet, wenn der Agent eine Aktion ausführt, die seine Präsenz im Problemraum beeinflusst. Beispielsweise kann ein Presence Penalty angewendet werden, um den Agenten dazu zu bringen, in einer bestimmten Region des Problemraums zu verweilen. Dadurch kann der Agent bessere Ergebnisse erzielen, indem er sich auf bestimmte Regionen des Problems konzentriert.

Changelog

| 09.05.2023 | Release v1.0.0 |